14. März 2025·7 Min.

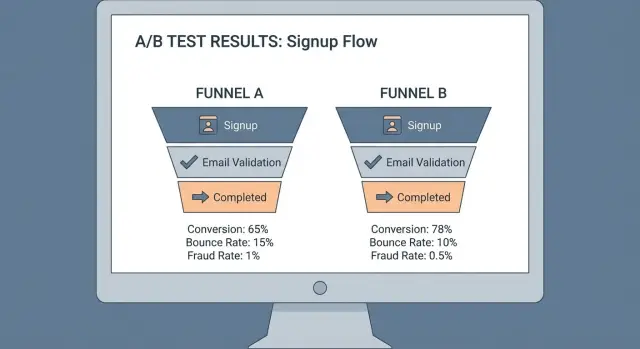

E‑Mail‑Qualitätstore per A/B‑Test prüfen, ohne das Anmeldewachstum zu beeinträchtigen

Lerne, wie du E‑Mail‑Qualitätstore per A/B‑Test prüfst: richtige Metriken, sinnvolle Segmente und stufenweises Rollout sorgen dafür, dass strengere Validierung die Qualität verbessert, ohne das Anmeldewachstum zu bremsen.

Warum E‑Mail‑Qualitätstore das Wachstum schädigen können, wenn man sie zu schnell ändert

E‑Mail‑Qualitätstore schützen dein Produkt, liegen aber direkt im Anmeldepfad. Wenn du die Validierung über Nacht strenger machst, verlierst du neben den schlechten auch echte Nutzer. Das Schwierige ist: der Schaden sieht oft wie „Wachstumsverlangsamung“ aus, obwohl deine E‑Mail‑Liste sauberer wird.

Das größte Wachstumsrisiko sind False Positives. Eine strenge Regel kann jemanden blockieren, der eine neue Domain nutzt, einen Firmenmailserver mit ungewöhnlichen Einstellungen hat oder eine gültige Adresse verwendet, die wegen eines temporären Problems bei einer Echtzeitprüfung scheitert. Dieser Nutzer sieht nicht „bessere Datenqualität“. Er sieht „Anmeldung fehlgeschlagen“ und geht.

Strengere Prüfungen können außerdem Reibung erzeugen. Zusätzliche Schritte wie das erneute Eingeben der E‑Mail, das Warten auf eine Verifizierung oder eine verwirrende Ablehnungsmeldung verlangsamen das Onboarding. Selbst kleine Verzögerungen zählen, wenn jemand dein Produkt zum ersten Mal ausprobiert.

Gleichzeitig wirken sich E‑Mail‑Qualität und -Sauberkeit direkt auf Kosten aus. Mehr ungültige Adressen bedeuten mehr Bounces, schlechtere Zustellbarkeit und ein höheres Risiko für deine Sender‑Reputation. Es verschwendet außerdem Vertriebs‑ und Supportzeit für Accounts, die niemals aktiv werden. Wegwerf‑E‑Mails und Spam‑Traps sind besonders problematisch, weil sie wie Anmeldungen aussehen, aber selten echte Nutzer werden.

Ein guter Rollout balanciert Wachstum und Sicherheit. Bevor du einen Test fährst, einigt euch darauf, was „Erfolg“ bedeutet. Meistens heißt das: die Anmelde‑Conversion bleibt innerhalb eines Guardrails, die nachgelagerte Qualität verbessert sich (Aktivierung, Trial‑zu‑Paid, verifizierte E‑Mail‑Rate), das Risiko sinkt (Bounces, Wegwerf‑Domains, verdächtige Anmeldungen) und die Erfahrung bleibt schnell.

Beispiel: Wenn du die Erkennung von Wegwerf‑E‑Mails mit einer API wie Verimail verschärfst, erwartest du möglicherweise einen sichtbaren Rückgang bei rohen Anmeldungen. Die Frage ist, ob sich bezahlte Konversionen und Zustellbarkeit genug verbessern, um das zu rechtfertigen — ohne legitime Nutzer zu blockieren, die das Produkt nur ausprobieren wollen.

Definiere dein E‑Mail‑Qualitätstor und was „strenger“ heißt

Bevor du etwas testest, beschreibe in einfachen Worten, was dein „Tor“ heute tut. Wenn du das nicht klar definierst, testest du am Ende eine Mischung aus Policy, UI‑Text und Nutzerintention.

Eine einfache Einordnung, was passiert, wenn eine E‑Mail risikoreich aussieht:

- Soft gate: Anmeldung erlauben, aber eine Warnung zeigen oder das Konto zur Prüfung markieren.

- Verify gate: Anmeldung erst nach Bestätigung der Adresse erlauben (z. B. per Code oder Bestätigungs‑E‑Mail).

- Hard block: Anmeldung verweigern, bis der Nutzer eine andere E‑Mail eingibt.

Liste als Nächstes auf, was du mit deinen aktuellen Tools tatsächlich erkennen kannst. Die meisten Teams starten mit offensichtlichen Fehlern und ergänzen dann höherwertige Risiken: ungültige Syntax, Domain‑Probleme, fehlende MX‑Einträge, Wegwerf‑Domains und bekannte Fallen oder hochriskante Muster (oft aus Blocklisten).

Auch der Ort des Gates ist wichtig. Ein Block im Anmeldeformular verändert das Wachstum stärker als derselbe Block später in einem Invite‑Flow, Checkout oder Lead‑Formular. Wähle einen Ort für den Test, damit klar ist, was die Änderung verursacht hat.

Definiere zuletzt „strenger“ aus Sicht des Nutzers. Strenge ist nicht nur Erkennung. Es ist die Erfahrung: die angezeigte Nachricht, ob Wiederholungen erlaubt sind und wie einfach Hilfe zu bekommen ist.

Ein konkretes Beispiel: Du behältst Syntax‑ und MX‑Checks als harte Blocks bei, behandelst aber die Erkennung von Wegwerf‑E‑Mails zunächst als Verify‑Gate. Mit einem Validator wie Verimail kannst du „ungültig“ von „Wegwerf“ trennen und für jeden Fall ein anderes Ergebnis wählen, statt alles pauschal abzulehnen.

Metriken, die du verfolgen solltest: Wachstum, Qualität und Sicherheit (mit Guardrails)

Wähle eine primäre Metrik und betrachte alles andere als unterstützende Indikatoren. Sonst kannst du „auf dem Papier gewinnen“, während du heimlich Anmeldungen kaputtmachst.

Beginne mit einer Wachstumsmetrik, die echten Erfolg widerspiegelt, nicht nur Formular‑Submits. Für die meisten Teams ist das die Anmelde‑Abschlussrate pro Variante. Hat dein Produkt einen schnellen „First Value“‑Moment, ist die Aktivierungsrate (z. B. verifizierte E‑Mail plus erste Schlüsselaktion innerhalb von 24 Stunden) oft aussagekräftiger.

Qualität ist der Bereich, in dem strengere Validierung sich auszahlen sollte. Verfolge nachgelagerte E‑Mail‑Ergebnisse, die für deine Sender‑Reputation wichtig sind: Bounce‑Rate bei der ersten Mail, Zustellbarkeit (Inbox vs Spam, falls verfügbar), Beschwerderate und Abmelderate. Diese Signale bewegen sich meist langsam, also lege ein Messfenster vorab fest (z. B. 7–14 Tage nach Anmeldung) und halte dich daran.

Sicherheitsmetriken zeigen, ob du die richtigen Leute blockierst. Beobachte Abuse‑ und Betrugssignale, die Zeit und Geld kosten: doppelte Accounts pro Nutzer, verdächtige Anmeldungen vom gleichen Gerät oder IP‑Bereich, spam‑artiges Verhalten nach der Anmeldung und Supporttickets zu „Ich habe keine Mail erhalten“. Wenn du etwas verkaufst, füge Chargebacks oder Rückerstattungsraten hinzu.

Geschäftsmetriken halten den Test ehrlich. Ein strengeres Gate kann Top‑of‑Funnel reduzieren, aber qualifizierte Leads und Trial‑zu‑Paid‑Konversion verbessern. Wenn bezahlte Konversion zu lange braucht, nutze einen Proxy wie Sales Accepted Leads, Product‑Qualified Leads oder Retention in der ersten Woche.

Setze Guardrails, damit du den Test früh stoppen kannst, wenn die Erfahrung leidet. Beobachte Seitenladezeit und zusätzliche Latenz beim E‑Mail‑Schritt, Formularfehler‑Rate (insbesondere „E‑Mail abgelehnt“) nach Gerät, Abbruch an der E‑Mail‑Stelle im Vergleich zum vorherigen Schritt, Hilfefragen zur Validierung oder Verifizierungs‑E‑Mails und eine Mindest‑Anmeldeabschlussrate (deine „Do‑Not‑Cross“‑Linie).

Beispiel: Wenn du die Erkennung von Wegwerf‑E‑Mails mit einem Tool wie Verimail verschärfst, kannst du einen kleinen Rückgang bei rohen Anmeldungen akzeptieren, aber nur wenn Aktivierung und frühe Retention steigen und Missbrauchsmeldungen sinken, ohne einen Anstieg von Formularfehlern.

Wähle Segmente, die deine Ergebnisse vertrauenswürdig machen

Wenn du ein strengeres Gate für „alle“ testest, kann das Ergebnis irreführend sein. Verschiedene Nutzer bringen verschiedene E‑Mail‑Gewohnheiten, Risikoprofile und Geduld für zusätzlichen Aufwand mit. Segmentierung hilft zu sehen, wo eine Policy die Qualität verbessert und wo sie heimlich gute Anmeldungen blockiert.

Wähle ein paar Segmente, die du jedes Mal reportest. Halte es klein, damit du nicht das beste Segment nachträglich auswählst. Ein guter Default ist, nach Ankunftsweg, Region und geschätztem Risiko zu segmentieren.

Segmente, die oft die größten Schwankungen erklären, sind Akquisitionskanal (Paid, Organic, Partner, In‑Product‑Invites), Region und Sprache, neue vs. wiederkehrende Nutzer, High‑Risk vs Low‑Risk‑Kohorten (basierend auf vorhandenen Signalen) und Geschäfts‑ vs. Privatadressen (wenn dein Produkt da unterschiedlich behandelt).

Sei explizit, was „High‑Risk“ für dein Business bedeutet. Häufige Signale sind sehr schnelle wiederholte Anmeldungen, viele Anmeldungen vom gleichen Gerät oder IP‑Bereich, ungewöhnliche Referral‑Muster oder eine Historie von Chargebacks und Missbrauch bei ähnlichen Profilen. Wenn du bereits ein Betrugsscore hast, nutze ihn für die Aufteilung.

Konkret: Paid‑Traffic in einem Land kann sich auf wenige lokale Mailprovider konzentrieren. Eine striktere Regel, die bestimmte Domains flaggt (oder Wegwerf‑E‑Mails aggressiv blockiert), sieht insgesamt vielleicht gut aus, kann aber Conversion in dieser Region zum Absturz bringen. Genau solche Probleme fängst du durch frühe Segmentierung ab.

Wenn du eine API wie Verimail nutzt, halte Segmentierung von der Validierungsentscheidung getrennt. Führe die gleichen Validierungschecks in allen Varianten aus und ändere nur die Policy (erlauben, warnen oder blockieren), damit deine Segmentvergleiche sauber bleiben.

Schritt‑für‑Schritt: einen sauberen A/B‑Test für Validierungsstrenge entwerfen

Mach aus Anmeldungen echte Nutzer

Spam‑Traps und minderwertige Leads stoppen, bevor sie Anmeldungszahlen verfälschen.

Ein sauberer Test beginnt mit einem Satz, den du verteidigen kannst: was genau wird strenger und was sollte sich dadurch verbessern. Zum Beispiel: „Wenn wir Wegwerf‑E‑Mails bei der Anmeldung blockieren, reduzieren wir Bounce‑Rate und Fake‑Trials und halten Paid‑Konversionen innerhalb von 1 % des heutigen Niveaus.“ Das macht den Trade‑off klar.

1) Definiere die Varianten (was Nutzer tatsächlich erleben)

Halte die Unterschiede klein und einfach zu erklären.

- Control: aktuelle Policy (Baseline)

- Soft warning: Anmeldung erlauben, aber zu einer Work/Personal‑Inbox raten (ein Klick zum Fortfahren)

- Hard block: Anmeldung verhindern bis eine andere E‑Mail eingegeben wird

- Step‑up verification: nur bei risikoreichen Adressen eine zusätzliche Bestätigung verlangen

Wenn du einen Validator wie Verimail nutzt, notiere, welche Signale den strengeren Pfad auslösen (Wegwerf‑Provider Treffer, ungültige Domain, fehlende MX, bekannte Spam‑Trap‑Risiken), damit die Varianten stabil bleiben.

2) Fixiere die Zuweisung und regle Wiederholungen

Weise auf Nutzer‑Ebene zu, nicht pro Session. Eine einfache Regel: das erste Mal, wenn du eine E‑Mail (oder Nutzer‑ID/Cookie) siehst, ordnest du die Person für die gesamte Testdauer einer Variante zu.

Lege fest, wie du mit Wiederholungen umgehst. Wenn jemand drei verschiedene E‑Mails ausprobiert, behalte die Variante und logge jeden Versuch, damit du „Reibung“ (zusätzliche Versuche) getrennt von echtem Abbruch messen kannst.

3) Laufzeit festlegen und gegen Kalender‑Rauschen schützen

Lauf lang genug, um Wochentags‑ und Wochenendverhalten einzubeziehen und idealerweise einen vollen Marketingzyklus, wenn du Kampagnen fährst. Wenn du während des Tests eine große Promo startest, notiere das und ziehe eine Verlängerung in Betracht, damit beide Varianten ähnliche Traffic‑Mixe sehen.

4) Stoppregeln und was „Gewinnen“ heißt

Definiere vorab Pass/Fail‑Regeln pro Segment, nicht nur insgesamt. Du willst in der Regel einen Qualitätsgewinn (niedrigere Bounces, weniger Wegwerf‑Signups, weniger Chargebacks), einen Wachstums‑Guardrail (Anmeldeabschluss darf um nicht mehr als X% fallen), einen Revenue‑Guardrail (Trial‑zu‑Paid oder Aktivierung darf nicht mehr als Y% fallen) und einen Sicherheits‑Guardrail (Supporttickets oder „kann sich nicht anmelden“‑Fehler dürfen nicht über Z% steigen). Setze außerdem eine minimale Stichprobengröße, damit du Ergebnisse nicht zu früh bewertest.

Das schützt davor, „auf Qualität zu gewinnen“, aber die Kunden zu verlieren, die du wirklich willst.

Stufenweise Rollout‑Taktiken, die Überraschungen reduzieren

Änderst du Validierungsregeln über Nacht, lernt dein Supportteam schnell: das Postfach wird lauter als das Metrik‑Dashboard. Ein stufenweiser Rollout liefert die gleichen Learnings mit kleinerer Blast‑Radius.

Starte mit einer Canary‑Cohort, bevor du einen sauberen Split fährst. Wähle einen kleinen Slice neuer Anmeldungen (z. B. 1 % des Traffics oder eine niedrigrisikobe Region) und wende dort das strengere Gate an. Beobachte die Basics über einen vollen Tag: Anmeldeabschluss, Zustellung der Verifizierungs‑E‑Mail und Beschwerdeaufkommen. Wenn etwas kaputtgeht, ist die Auswirkung klein.

Nach einer stabilen Canary rampst du in Schritten hoch statt sofort auf 50/50 zu springen. Ein einfacher Ramp‑Plan:

- 1 % für 24 Stunden

- 5 % für 24 Stunden

- 25 % für 48 Stunden

- 50 % für 48 Stunden

- 100 % (oder in dein formelles Experiment)

Mach es leicht, zu stoppen. Baue einen Not‑Aus‑Schalter ein, damit du zur vorherigen Policy zurückkehren kannst, ohne Code zu deployen.

Definiere außerdem einen Fallback für Randfälle. Wenn dein Validator ausfällt oder DNS instabil ist, erlaubst du dann die Anmeldung, markierst das Konto oder verlangst Verifizierung vor Zugriff?

Logging macht aus einem Rollout eine Lernschleife. Speichere für jede blockierte oder herausgeforderte Adresse einen klaren Entscheidungsgrund (Syntax ungültig, keine MX‑Einträge, Wegwerf, vermutete Spam‑Trap, blocklistete Domain). Tools wie Verimail liefern diese Signale in Millisekunden, was das Debuggen echter Fälle praktikabel macht.

Plane schließlich für Traffic‑Spitzen und spezielle Provider. Bei Traffic‑Surges steigen Timeouts und False Blocks. Setze Rate‑Limits, überwache Latenzen und halte ein Allowlist‑Verfahren parat für legitime Unternehmensdomains, die wegen strikter DNS‑Setups fehlschlagen.

Die Anmeldung glatt halten, während du das Gate verschärfst

Strengere Validierung scheitert, wenn sie für gute Nutzer zufällig wirkt. Behandle deine E‑Mail‑Prüfung wie einen hilfreichen Hinweis, nicht wie Bestrafung. Das zählt besonders während Tests, weil verwirrende Meldungen den tatsächlichen Effekt verschleiern.

Formuliere Fehlermeldungen so, dass Nutzer wissen, was zu tun ist. „Diese E‑Mail sieht ungültig aus“ ist vage. „Überprüfe auf fehlendes @, Leerzeichen oder einen Tippfehler wie gmial.com“ hilft in Sekunden.

Gib einfache Wege zum erneuten Versuch. Viele „schlechten“ Adressen sind einfache Tippfehler. Schlage automatisch gängige Domains vor, wenn jemand „gamil“ oder „hotmial“ tippt, und erkenne fehlende Punkte (z. B. gmailcom). Mit einem Validator wie Verimail kannst du Domain‑ und MX‑Probleme früh erkennen und klar erklären: „Wir können diese Domain nicht erreichen. Versuch eine andere Adresse.“

Entscheide vor dem Launch, wie du mit Wegwerf‑E‑Mails umgehst. Es gibt keine eine richtige Antwort, aber sei konsistent: blockieren, wenn Missbrauch hohe Kosten verursacht (Free Trials, Credits), warnen, wenn du weniger Reibung willst, oder Anmeldung erlauben, aber Verifizierung vor wichtigen Aktionen verlangen.

Baue ein Ausnahmen‑Verfahren. Wenn legitime Partner‑ oder Kundendomains False Positives auslösen, führe eine kleine Allowlist und überprüfe sie regelmäßig, damit sie nicht zum Schlupfloch wird.

Entscheide außerdem, wann du nach der Anmeldung erneut prüfst. Ein gängiges Muster: leichte Prüfungen bei der Anmeldung, strengere Checks vor der ersten ausgehenden Mail, vor dem Upgrade auf bezahlte Pläne oder vor der ersten risikoreichen Aktion. Ein Nutzer mit einer grenzwertigen Adresse kann z. B. eine Trial starten, muss aber vor Team‑Einladungen oder Zahlungsangaben verifizieren.

Häufige Fehler, die Tests irreführend machen

Risiko‑E‑Mails zuverlässig filtern

Echtzeitabgleich mit Tausenden Wegwerf‑Providern und bekannten risikoreichen Quellen.

Die schnellste Art, ein Experiment falsch zu lesen, ist nur die Anmeldung zu beurteilen. Ein strengeres Gate kann am ersten Tag „schlecht“ aussehen und trotzdem Zustellbarkeit verbessern, Rückerstattungen reduzieren und Supportzeit senken, weil weniger Fake‑ oder fehlerhafte Adressen im System landen. Lege vorher fest, welche nachgelagerten Ergebnisse zählen und wie lange du wartest.

Ein weiterer Fehler ist, mehr als eine Sache zu ändern. Wenn du Validierungsstärke anpasst und gleichzeitig Copy, zusätzliche Felder oder Fehlertexte veränderst, weißt du nicht, was das Ergebnis verursacht hat. Halte den Test langweilig: eine Regeländerung, eine klare Hypothese.

Fehler, die oft zu falschen Gewinnern oder Alarmen führen:

- Nur Anmeldungen tracken, nicht spätere Signale wie Bounce‑Rate, Zustellbarkeit, Aktivierung oder Chargebacks.

- Produktänderungen mit Policy‑Änderungen mischen (Copy, UI und Validierung gleichzeitig ändern).

- Randomisierung nach Session statt Nutzer, so dass ein Benutzer bei Wiederholungen unterschiedliche Regeln sieht.

- Blockierte Nutzer mit „Abgebrochenen“ zusammenfassen, wodurch verborgen bleibt, ob die Regel falsch war oder die Nachricht unklar.

- Randfälle vernachlässigen: neue Domains, Unternehmensmail‑Gateways, Plus‑Addressing und Aliasse.

Achte besonders auf die Trennung „blocked vs abandoned“. Ein blockierter Nutzer ist eine Policy‑Entscheidung. Ein abgebrochener Nutzer ist oft ein UX‑Problem, z. B. unklare Fehlermeldungen oder kein Weg, einen Tipp zu korrigieren.

Zu starkes Blockieren ist gefährlich. Wegwerf‑Erkennung ist nützlich, aber leicht fängst du legitime Adressen, besonders von neuen Domains oder Unternehmensrelays. Tools wie Verimail helfen, indem sie Syntax‑Checks, Domain‑/MX‑Verifikation und Blocklist‑Matching kombinieren, sodass dein Test eine Policy‑Entscheidung prüft und nicht versehentliche False Positives.

Schnelle Pre‑Launch‑Checkliste

Bevor du startest, stimmt alle auf dieselbe Definition von „Erfolg“ und „sicher weiter“ ab. Die meisten Tests scheitern, weil der Rollout vage war, das Dashboard wichtige Signale vermisste oder das Team nicht erklären konnte, warum ein echter Nutzer geblockt wurde.

Schreibe die Varianten in einfacher Sprache nieder. Beispiel: Control akzeptiert jede Adresse, die Syntax‑ und Domain‑Checks besteht, während Variante bekannte Wegwerf‑Provider und verdächtige Muster blockiert. Dokumentiere auch, wie der Traffic hochgefahren wird (z. B. 5 % → 25 % → 50 %) und die genaue Rollback‑Bedingung (z. B. „Anmelde‑Conversion fällt mehr als X% für Y Stunden“).

Kurze Checkliste für Growth, Engineering und Support:

- Varianten und Rollout‑Schritte sind dokumentiert, inklusive wer den Schalter umlegt und wie du innerhalb von Minuten revertierst.

- Dein Dashboard ist bereit und wird beobachtet: Anmelde‑Conversion, Aktivierung (erste Schlüsselaktion), Bounce‑Rate, Spam‑Beschwerden und Betrugssignale (Chargebacks, mehrere Anmeldungen pro Gerät, verdächtige IP‑Cluster).

- Segmente sind vorab vereinbart mit realistischen Stichprobengrößen (neu vs. zurückkehrend, Paid vs. Organic, Geos und Geschäfts‑ vs. Privatdomains).

- Logging ist detailliert genug zum Debuggen: jeder Block/Allow‑Entscheidung liegt ein Reason‑Code bei plus Domain und Providerkategorie (z. B. Wegwerf, Free‑Mailbox, Custom‑Domain).

- Support und Ops haben ein kurzes Playbook: was man blockierten Nutzern sagt, wie Beispiele gesammelt werden und wie False Positives schnell eskaliert werden.

Mach einen kleinen Trockentest in einer sicheren Umgebung (interne Accounts oder ein winziger Traffic‑Slice). Wenn du fünf zufällige Entscheidungen nicht erklären kannst (warum sie passierten), bist du nicht bereit für echte Anmeldungen.

Beispiel: Wegwerf‑E‑Mail‑Regeln verschärfen, ohne Trials zu killen

Mach dein Experiment sauberer

Trennung von Erkennung und Policy, damit deine A/B‑Ergebnisse das Nutzererlebnis widerspiegeln.

Ein B2B‑SaaS‑Team hat viele Trial‑Anmeldungen, aber Sales beschwert sich: viele Leads verschwinden, Support sieht spam‑artige Accounts. Ein Audit zeigt ein Muster: viele Trials nutzen Wegwerf‑Inboxen und aktivieren nie.

Vor Änderungen setzen sie ein Baseline‑Monitoring auf (aktuell: alle E‑Mails erlauben). Zwei Wochen lang tracken sie Bounce‑Rate der ersten Produktmail, Trial‑zu‑Aktivierung (erste Schlüsselaktion) und „bad signups“ (Accounts, die wegen Missbrauch oder offensichtlicher Fake‑Daten markiert werden). Als Guardrail legen sie fest: die Gesamt‑Anmelde‑Conversion darf nicht mehr als eine kleine vereinbarte Schwelle fallen.

Dann testen sie drei Erlebnisse:

- Control: Wegwerf‑E‑Mails wie bisher erlauben.

- Soft warning: erlauben, aber klare Nachricht anzeigen („Verwende eine Geschäfts‑E‑Mail, um vollen Zugriff zu bekommen“) und um Bestätigung bitten.

- Hard block: bekannte Wegwerf‑Provider ablehnen und um eine andere Adresse bitten.

Die Validierung nutzt einen Wegwerf‑Provider‑Check plus grundlegende Hygiene (Syntax, Domain, MX). Mit einer API wie Verimail ist das in einem Aufruf bei der Anmeldung möglich, sodass jede Variante dieselbe Erkennung erhält.

Das Rollout ist gestaffelt. Sie beginnen nur mit Paid‑Traffic, weil dort oft mehr Missbrauch auftritt und ROI klarer ist. Halten Guardrails nach ein paar Tagen, erweitern sie auf andere Quellen.

Die Entscheidung ist nicht „eine Policy für alle“. Die Ergebnisse zeigen: Hard‑Block verbessert Aktivierung und reduziert Missbrauch in High‑Risk‑Segmenten (Paid Search, bestimmte Geos, sehr schnelles Formularausfüllen), schadet aber der Conversion in Low‑Risk‑Segmenten (Invites, organischer Brand‑Traffic). Sie behalten strikte Blockierung dort, wo es sich lohnt, und nutzen softere Warnungen anderswo.

Nächste Schritte: mach strengere Validierung zu einem stabilen Teil deines Growth‑Systems

Hast du einen klaren Gewinner, behandle ihn wie ein Produkt‑Feature, nicht als einmaligen Growth‑Hack. Ziel ist Konsistenz: dieselben Eingaben sollten immer dieselbe Entscheidung erhalten, mit schnellem Rollback‑Weg.

Schreibe die gewonnene Policy als einfache Regelmenge nieder und verknüpfe sie mit Segmenten. Beispiel: Neue Accounts aus High‑Risk‑Geos bekommen strengere Wegwerf‑Erkennung, während vertraute wiederkehrende Nutzer nur Basischecks sehen.

Nach dem Test weiter überwachen

E‑Mail‑Qualität ist nicht statisch. Wegwerf‑Provider tauchen auf, Spam‑Traps rotieren und Betrugsmuster ändern sich. Setze ein wöchentliches Review auf, das sich auf Outcomes konzentriert, nicht nur Anmeldevolumen.

Tracke ein kleines Set an Signalen, die sich richtig entwickeln sollten, wenn dein Gate funktioniert: Bounce‑Rate und Hard‑Bounces bei Aktivierungs‑Mails, Beschwerderate und plötzliche Abmelde‑Spikes, Trial‑zu‑Aktivierung und Retention in der ersten Woche, Betrugsindikatoren wie wiederholte Signups pro Gerät oder IP und Supporttickets über geblockte Anmeldungen.

Validierung automatisieren, damit die Regel zuverlässig greift

Manuelle Prüfungen oder inkonsistente clientseitige Logik erzeugen verrauschte Ergebnisse und unfairen Nutzererlebnisse. Baue die Validierung in deinen Anmeldeflow ein, sodass jede Anfrage schnell und gleich bewertet wird.

Wenn du eine API‑basierte Lösung willst: Verimail (verimail.co) kann Syntax, Domains, MX‑Einträge und Wegwerf‑Provider in einem Aufruf validieren, was hilft, Policies über Web, Mobile und Partner‑Signups konsistent zu halten.

Starte auch nach „Pick a winner“ klein. Rolle auf einen kleinen Prozentsatz aus, beobachte Guardrails eine volle Woche und erweitere dann. Halte einen klaren Rollback‑Pfad (Feature‑Flag oder Konfig‑Switch), damit du das Gate schnell lockern kannst, wenn Wachstum oder Zustellbarkeit zu stark leiden.

FAQ

Was genau heißt es, ein E‑Mail‑Qualitätstor “strenger” zu machen?

Beginne damit, klar zu beschreiben, was sich für den Nutzer ändert: willst du nur warnen, Verifizierung verlangen oder blockieren? Der sicherste Weg ist zunächst, die Erkennung zu verschärfen, aber das Ergebnis erst einmal weich zu halten und nur zu eskalieren, wenn sich die Qualität verbessert, ohne die Anmelde‑Conversion zu brechen.

Warum kann strengere Validierung das Wachstum schädigen, obwohl die E‑Mail‑Qualität besser wird?

False Positives sind das größte Risiko. Eine gültige Adresse kann wegen temporärer DNS‑Probleme, ungewöhnlicher Unternehmensmail‑Setups oder einer neuen Domain durchrutschen und der Nutzer sieht nur „Anmeldung fehlgeschlagen“ und geht weg. Strengere Regeln erhöhen außerdem Reibung, wenn sie zusätzliche Schritte oder verwirrende Fehlermeldungen einführen.

Wann sollte ich ein Soft‑Gate, Verifizierungs‑Gate oder ein Hard‑Block verwenden?

Verwende ein soft gate, wenn du wenig Reibung willst und Nutzer nur zur besseren Nutzung nudgen möchtest. Nutze ein verify gate, wenn du höhere Sicherheit brauchst, bevor Nutzer Zugriff auf wichtige Aktionen bekommen. Setze ein hard block ein, wenn Missbrauch sehr kostspielig ist und das Signal sehr zuverlässig ist (z. B. eindeutig fehlerhafte Syntax oder wirklich unerreichbare Domains).

Welche Metriken sollte ich verfolgen, um zu beurteilen, ob strengere Validierung sich lohnt?

Verfolge eine primäre Wachstumsmetrik wie Anmelde‑Abschluss oder Aktivierung und unterstütze sie mit Qualitäts‑ und Risiko‑Metriken. Praxisnah sind Bounce‑Rate der ersten Mail, verifizierte E‑Mail‑Rate, frühe Retention, Anteil Wegwerf‑Adressen, Missbrauchs‑Flags und Supportanfragen zu fehlenden Mails. Lege Guardrails fest, bei deren Überschreiten du den Test stoppst.

Welche Segmente sind beim Testen von E‑Mail‑Validierungsänderungen am wichtigsten?

Achte auf Durchschnittsverzerrungen: segmentiere nach Akquisitionskanal, Region/Sprache, neue vs. wiederkehrende Nutzer und Geschäfts‑ vs. Privatadressen. Füge eine einfache „Risk‑Split“ anhand vorhandener Betrugs‑Signale hinzu. Halte die Segmentierung stabil, damit du nicht nachträglich cherry‑pickst.

Wie vermeide ich inkonsistente Ergebnisse, wenn Nutzer verschiedene E‑Mails ausprobieren?

Setze Nutzer beim ersten Kontakt auf eine Variante fest (per Nutzer‑ID oder stabiler Cookie plus eingegebene E‑Mail). Entscheide vorher, wie du Wiederholungen behandelst: gleiche Variante behalten und jeden Versuch loggen, damit du zusätzliche Reibung (mehr Versuche) getrennt von tatsächlichem Abbruch messen kannst.

Wie rolle ich strengere Regeln sicher aus, ohne überrascht zu werden?

Canary zuerst, dann stufenweise ausrollen. Ein praktischer Plan ist 1 % für 24 h, dann 5 % für 24 h, 25 % für 48 h, 50 % für 48 h und anschließend Vollausrollung oder formelles Experiment. Stelle einen schnellen Abschalter bereit, damit du ohne Deploy zurückrollen kannst.

Wie kann ich die Validierung verschärfen, ohne die Anmeldung strafend wirken zu lassen?

Setze auf Klarheit und schnelle Erholung. Sag Nutzern genau, was sie als Nächstes tun sollen (Tipp zur Korrektur eines Tippfehlers, andere Adresse probieren oder verifizieren) und ermögliche einfache Wiederholungen. Viele „schlechten“ Mails sind Tippfehler, hilfreiche Hinweise und Autokorrekturen retten oft Conversions.

Welche häufigen Fehler machen Tests irreführend?

Mach nicht zu viele Änderungen auf einmal. Wenn du Policy‑Änderungen mit Copy‑ oder UI‑Änderungen kombinierst, weißt du nicht, was den Effekt verursacht hat. Beurteile Tests nicht nur über rohe Anmeldungen, sondern ziehe auch nachgelagerte Signale wie Bounces, Aktivierung und Missbrauch heran.

Wie kann Verimail mir helfen, Wegwerf‑E‑Mails zu erkennen, ohne reale Nutzer zu blockieren?

Behandle verschiedene Fehlertypen unterschiedlich statt alles abzulehnen. Mit einer API wie Verimail kannst du ungültige Adressen von Wegwerf‑Adressen trennen und Outcomes differenzieren: Hard‑Block bei offensichtlicher Syntax‑/MX‑Fehlern, aber Warnung oder Verifizierung bei Wegwerf‑Treffer. So reduzierst du schlechte Signups, ohne legitime Nutzer auszusperren.