14 mars 2025·8 min

Tester en A/B des portes de qualité d'email sans freiner la croissance des inscriptions

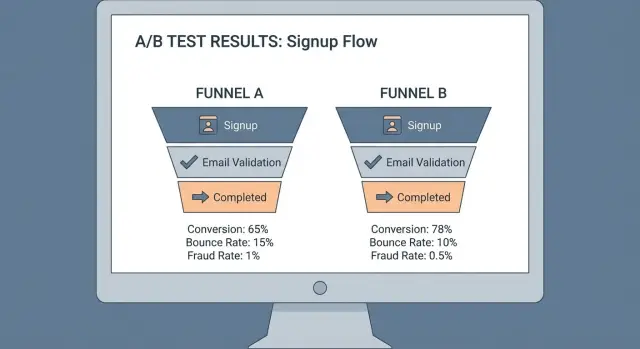

Apprenez à tester en A/B des portes de qualité d'email avec les bonnes métriques, segments et un déploiement progressif pour que la validation plus stricte améliore la qualité sans freiner la croissance.

Pourquoi des portes de qualité d'email peuvent freiner la croissance si vous les changez trop vite

Les portes de qualité d'email protègent votre produit, mais elles sont au cœur du parcours d'inscription. Si vous renforcez la validation du jour au lendemain, vous pouvez perdre des utilisateurs réels en même temps que les mauvais. Le problème délicat est que le dommage ressemble à un « ralentissement de la croissance », même si votre liste d'emails devient plus propre.

Le plus grand risque pour la croissance, ce sont les faux positifs. Une règle stricte peut bloquer quelqu'un utilisant un domaine nouveau, un serveur mail d'entreprise avec des paramètres inhabituels, ou une adresse valide qui échoue à une vérification en temps réel pour une raison temporaire. Cet utilisateur ne voit pas « une meilleure qualité de données ». Il voit « inscription échouée » et part.

Des contrôles plus stricts peuvent aussi ajouter de la friction. Des étapes supplémentaires comme retaper l'email, attendre une vérification ou voir un message de rejet confus peuvent ralentir l'onboarding. Même de petits retards comptent quand quelqu'un essaie votre produit pour la première fois.

En parallèle, la qualité des emails affecte directement les coûts. Plus d'adresses invalides signifie plus de rebonds, une délivrabilité détériorée et un risque pour votre réputation d'expéditeur. Cela gaspille aussi le temps des ventes et du support sur des comptes qui n'activeront jamais. Les emails jetables et les spam traps sont particulièrement pénibles parce qu'ils ressemblent à des inscriptions mais deviennent rarement de vrais utilisateurs.

Un bon déploiement équilibre croissance et sécurité. Avant de lancer un test, mettez-vous d'accord sur ce que « succès » signifie. En général il s'agit que le taux de conversion des inscriptions reste dans un garde-fou, que la qualité en aval s'améliore (activation, passage payant, taux d'email vérifié), que le risque diminue (rebonds, domaines jetables, inscriptions suspectes) et que l'expérience reste rapide.

Exemple : si vous renforcez la détection des emails jetables avec une API comme Verimail, attendez-vous à une baisse visible des inscriptions brutes. La question est de savoir si les conversions payantes et la délivrabilité s'améliorent suffisamment pour le justifier, sans bloquer les utilisateurs légitimes qui veulent juste essayer le produit.

Définissez votre porte de qualité d'email et ce que « plus strict » signifie

Avant de tester quoi que ce soit, écrivez en termes simples ce que votre « porte » fait aujourd'hui. Si vous ne la définissez pas clairement, vous finirez par tester un mélange de politique, de texte d'interface et d'intention utilisateur en même temps.

Une façon simple de cadrer la porte est par ce qui arrive quand un email semble risqué :

- Porte douce : autoriser l'inscription, mais afficher un avertissement ou marquer le compte pour révision.

- Porte de vérification : autoriser l'inscription seulement après que l'utilisateur ait confirmé l'adresse (par exemple via un code ou un e-mail de confirmation).

- Blocage strict : refuser l'inscription jusqu'à ce que l'utilisateur saisisse une autre adresse.

Ensuite, listez ce que vous pouvez réellement détecter avec vos outils actuels. La plupart des équipes commencent par les échecs évidents puis ajoutent des contrôles à plus fort signal : syntaxe invalide, problèmes de domaine, enregistrements MX manquants, domaines jetables, et pièges connus ou motifs à haut risque (souvent issus de listes de blocage).

L'endroit où la porte est appliquée compte autant que la règle. Un blocage au formulaire d'inscription change plus la croissance que le même blocage plus tard dans un flux d'invitation, de paiement ou un formulaire de lead. Choisissez un emplacement pour le test afin de savoir ce qui a causé le changement.

Enfin, définissez « plus strict » du point de vue de l'utilisateur. La stricteté n'est pas que détection. C'est l'expérience : le message affiché, si vous autorisez des réessais et la facilité d'obtenir de l'aide.

Un exemple concret : vous pouvez garder les contrôles de syntaxe et MX comme blocages stricts, mais traiter la détection d'emails jetables comme une porte de vérification d'abord. Avec un validateur comme Verimail, vous pouvez séparer « invalide » de « jetable » et choisir des résultats différents pour chacun au lieu de tout transformer en un écran de refus brut.

Métriques à suivre : croissance, qualité et sécurité (avec garde-fous)

Choisissez une métrique principale et traitez tout le reste comme des preuves de soutien. Sinon vous pouvez « gagner » sur papier tout en cassant silencieusement les inscriptions.

Commencez par une métrique de croissance qui reflète le vrai succès, pas seulement les soumissions de formulaire. Pour la plupart des équipes, c'est le taux d'achèvement d'inscription par variante. Si votre produit a un « first value » rapide, le taux d'activation (par exemple email vérifié plus première action clé dans les 24 heures) est souvent meilleur.

La qualité est là où la validation plus stricte doit payer. Suivez les résultats emails en aval qui comptent pour votre réputation d'expéditeur : taux de rebond du premier email, délivrabilité (boîte de réception vs spam si vous avez ces mesures), taux de plaintes et taux de désabonnement. Ceux-ci évoluent généralement lentement, donc définissez une fenêtre de mesure à l'avance (par exemple 7-14 jours après inscription) et tenez-vous-y.

Les métriques de sécurité vous indiquent si vous bloquez les bonnes personnes. Surveillez les signaux d'abus et de fraude qui coûtent du temps et de l'argent : comptes dupliqués par utilisateur, inscriptions suspectes depuis le même appareil ou plage IP, comportements spam après inscription, et tickets support liés à l'accès au compte ou au « je n'ai jamais reçu l'email ». Si vous vendez quelque chose, ajoutez les rétrofacturations ou le taux de remboursement.

Les métriques business gardent le test honnête. Une porte plus stricte peut réduire les inscriptions en haut d'entonnoir mais améliorer les leads qualifiés et la conversion essai→payant. Si la conversion payante prend trop de temps, utilisez un proxy comme sales-accepted leads, product-qualified leads ou la rétention de la première semaine.

Mettez en place des garde-fous pour arrêter le test précocement si l'expérience casse. Surveillez le temps de chargement des pages et la latence ajoutée à l'étape email, le taux d'erreur de formulaire (en particulier « email rejeté ») par appareil, l'abandon sur le champ email comparé à l'étape précédente, les demandes d'aide concernant la validation ou les emails de vérification, et un plancher global du taux d'achèvement d'inscription (votre ligne « à ne pas dépasser »).

Exemple : si vous renforcez la détection des jetables avec un outil comme Verimail, vous pourriez accepter une petite baisse des inscriptions brutes, mais seulement si l'activation et la rétention précoce augmentent et que les signalements d'abus diminuent, sans pic d'erreurs de formulaire.

Choisir des segments qui rendent vos résultats fiables

Si vous testez une porte plus stricte sur « tout le monde », le résultat peut être trompeur. Les utilisateurs diffèrent par leurs habitudes d'email, leur niveau de risque et leur patience pour la friction supplémentaire. La segmentation vous aide à voir où une politique améliore la qualité et où elle bloque silencieusement de bonnes inscriptions.

Choisissez quelques segments que vous reporterez à chaque fois. Gardez-les peu nombreux pour ne pas finir par sélectionner la tranche la plus flatteuse. Un bon défaut est de segmenter par provenance, localisation et niveau de risque apparent.

Les segments qui expliquent généralement les plus grands écarts incluent le canal d'acquisition (payant, organique, partenaires, invitations in-product), la région et la langue, nouveaux vs récurrents, cohortes à haut risque vs faible risque (basées sur vos signaux existants), et emails professionnels vs personnels (si votre produit les traite différemment).

Soyez explicite sur ce que « haut risque » signifie pour votre activité. Signaux communs : inscriptions répétées très rapides, nombreuses inscriptions depuis le même appareil ou plage IP, motifs de référencement inhabituels, ou historique de rétrofacturations et abus liés à profils similaires. Si vous notez déjà les inscriptions pour fraude, utilisez ce score pour séparer le reporting.

Un exemple concret : le trafic payant dans un pays peut surpondérer certains fournisseurs de boîtes locaux. Une règle plus stricte qui signale certains domaines (ou bloque agressivement les jetables) peut sembler correcte globalement, mais faire chuter les conversions uniquement dans cette région. C'est exactement le genre de problème que vous attrapez en segmentant tôt.

Si vous utilisez une API de validation d'emails comme Verimail, gardez la segmentation séparée de la décision de validation elle-même. Exécutez les mêmes vérifications de validation entre variantes, mais changez seulement la politique (autoriser, avertir, bloquer) pour que les comparaisons de segments restent propres.

Étape par étape : concevoir un A/B test propre pour la stricte de validation

Transformer les inscriptions en utilisateurs réels

Arrêtez les spam traps et les leads de faible qualité avant qu'ils n gonflent vos chiffres d'inscription.

Un test propre commence par une phrase que vous pouvez défendre : qu'est-ce qui devient plus strict exactement, et qu'est-ce qui devrait s'améliorer grâce à cela. Par exemple : « Si nous bloquons les emails jetables à l'inscription, nous réduirons le taux de rebond et les essais frauduleux, tout en maintenant les conversions payantes dans 1% du niveau actuel. » Cela rend le compromis clair.

1) Définir les variantes (ce que vivent réellement les utilisateurs)

Gardez la différence entre groupes petite et facile à expliquer.

- Contrôle : politique actuelle (baseline)

- Avertissement doux : autoriser l'inscription, mais inciter à utiliser une boîte pro/personnelle (un clic pour continuer)

- Blocage strict : empêcher l'inscription jusqu'à une autre adresse

- Vérification progressive : exiger une étape supplémentaire (comme confirmer un email) seulement pour les adresses risquées

Si vous utilisez un validateur comme Verimail, notez quels signaux déclenchent le chemin plus strict (correspondance fournisseur jetable, domaine invalide, MX manquant, risque de spam trap connu) pour que les variantes restent stables.

2) Verrouiller l'assignation et gérer les réessais

Attribuez au niveau utilisateur, pas au niveau session. Une règle simple : la première fois que vous voyez un email (ou un ID utilisateur/cookie), vous le fixez dans une variante pour toute la durée du test.

Décidez comment traiter les réessais à l'avance. Si quelqu'un essaie trois emails différents, gardez-le dans la même variante et loggez chaque tentative pour mesurer la « friction » (tentatives supplémentaires) séparément de l'abandon réel.

3) Fixer la durée et se protéger du bruit calendaire

Exécutez assez longtemps pour inclure comportement en semaine et le week-end, et idéalement un cycle marketing complet si vous lancez des campagnes. Si vous lancez une grosse promo en plein test, notez-le et envisagez d'allonger le test pour que les deux variantes voient un mix de trafic similaire.

4) Décider des règles d'arrêt et de ce que signifie « gagner »

Avant de commencer, définissez les règles de réussite/échec par segment, pas seulement globalement. Vous voudrez généralement une victoire qualité (moins de rebonds, moins d'inscriptions jetables, moins de rétrofacturations ou flags de fraude), un garde-fou croissance (le taux d'achèvement d'inscription ne peut pas chuter de plus de X%), un garde-fou revenu (essai→payant ou activation ne peut pas chuter de plus de Y%) et un garde-fou sécurité (tickets support ou erreurs « impossible de s'inscrire » ne peuvent pas exploser au-delà de Z%). Fixez aussi un échantillon minimum pour ne pas appeler un résultat trop tôt.

Cela vous empêche de « gagner » sur la qualité en perdant les clients que vous voulez réellement.

Tactiques de déploiement progressif qui réduisent les surprises

Si vous changez les règles du jour au lendemain, vous apprendrez vite une chose : votre boîte support devient plus bruyante que votre dashboard métrique. Un déploiement progressif vous donne les mêmes apprentissages avec moins de surprises.

Commencez par un cohort canari avant de lancer un split propre. Choisissez une petite part des nouvelles inscriptions (par exemple 1% du trafic ou une région à faible risque) et appliquez la porte plus stricte là-bas. Surveillez les bases pendant un cycle complet : complétion d'inscription, livraison des emails de vérification et volume de plaintes. Si quelque chose casse, vous avez un faible rayon d'impact.

Après que le canari soit stable, montez par étapes au lieu de passer directement à 50/50. Un plan de montée simple :

- 1% pendant 24 heures

- 5% pendant 24 heures

- 25% pendant 48 heures

- 50% pendant 48 heures

- 100% (ou passage à l'expérience formelle)

Facilitez l'arrêt. Ajoutez un interrupteur d'arrêt d'urgence pour revenir à la politique précédente sans déployer de code.

Définissez aussi une solution de repli pour les cas limites. Si votre validateur expire ou si le DNS est instable, autorisez-vous l'inscription mais marquez le compte, ou exigez la vérification avant l'accès ?

Le logging transforme un déploiement en boucle d'apprentissage. Enregistrez une raison claire pour chaque adresse bloquée ou challengée (syntaxe invalide, pas d'enregistrement MX, jetable, suspicion de spam trap, domaine blocklisté). Des outils comme Verimail retournent ces signaux en millisecondes, ce qui rend pratique de déboguer des cas réels plutôt que de deviner.

Enfin, prévoyez les pics et les fournisseurs particuliers. Lors de pics de trafic, les timeouts augmentent et les faux blocages peuvent sauter. Mettez des limites de débit, surveillez la latence et gardez un processus d'autorisation pour les domaines d'entreprise légitimes qui échouent aux contrôles à cause de configurations DNS strictes.

Garder l'expérience d'inscription fluide pendant que vous renforcez la porte

Une validation plus stricte échoue quand elle paraît aléatoire aux bons utilisateurs. Traitez votre contrôle d'email comme un indice utile, pas une punition. Cela compte d'autant plus pendant les tests, car des messages confus peuvent masquer le vrai impact de votre politique.

Rédigez des messages d'erreur qui disent aux gens exactement quoi faire ensuite. « Cet email semble invalide » est vague. « Vérifiez la présence d'un @, d'espaces ou une faute courante comme gmial.com » aide quelqu'un à corriger en secondes.

Donnez un chemin de réessai facile. Beaucoup d'« mauvais » emails sont de simples fautes de frappe, pas de la fraude. Suggérez automatiquement des domaines courants quand quelqu'un tape « gamil » ou « hotmial », et détectez les points manquants (comme gmailcom). Si vous utilisez un validateur tel que Verimail, vous pouvez aussi détecter tôt les problèmes de domaine et MX, puis les expliquer simplement : « Nous ne pouvons pas joindre ce domaine email. Essayez une autre adresse. »

Décidez comment traiter les emails jetables avant de lancer. Il n'existe pas de réponse unique, mais soyez cohérent : bloquez quand l'abus coûte cher et que les comptes ont un vrai coût (essais gratuits, crédits), avertissez quand vous voulez moins de friction mais inciter à la qualité, ou autorisez l'inscription mais exigez la vérification avant les actions clés (inviter des coéquipiers, exporter, facturation).

Construisez un plan d'exceptions. Si vous avez des domaines partenaires ou clients légitimes qui déclenchent des faux positifs, gardez une petite liste d'autorisation et révisez-la chaque mois pour qu'elle ne devienne pas une faille.

Enfin, choisissez quand reverifier après l'inscription. Un schéma courant est des contrôles légers à l'inscription, puis des contrôles plus stricts au premier envoi sortant, avant l'upgrade payant, ou avant la première action à haut risque. Par exemple, un utilisateur qui s'inscrit avec une adresse limite peut commencer un essai, mais doit vérifier avant d'inviter une équipe ou d'entrer des informations de paiement.

Erreurs fréquentes qui rendent les tests trompeurs

Rendre les déploiements plus faciles à expliquer

Retournez des codes de raison clairs pour que le support débogue les blocages sans deviner.

La façon la plus rapide de mal lire une expérience est de la juger seulement par la conversion d'inscription. Une porte plus stricte peut sembler « négative » le premier jour, mais améliorer la délivrabilité, réduire les remboursements et diminuer le temps de support parce que moins d'adresses fausses ou cassées entrent dans votre système. Décidez à l'avance quels résultats en aval comptent et combien de temps vous attendrez pour qu'ils apparaissent.

Un autre problème courant est de changer plus d'une chose à la fois. Si vous ajustez la stricte de validation tout en changeant le copy du formulaire, ajoutant des champs ou déplaçant les messages d'erreur, vous ne saurez pas ce qui a causé le résultat. Gardez le test ennuyeux : un changement de règle, une hypothèse claire.

Erreurs qui génèrent le plus souvent de faux gagnants ou de fausses alertes :

- Ne suivre que les inscriptions, pas les signaux ultérieurs comme le taux de rebond, la délivrabilité, l'activation d'essai ou les rétrofacturations.

- Mélanger changements produit et changements de politique (copy, UI et validation qui évoluent simultanément).

- Randomiser par session au lieu d'utilisateur, de sorte qu'une personne qui réessaye voit des règles différentes et obtient des résultats incohérents.

- Regrouper les utilisateurs « bloqués » avec les utilisateurs « abandonnés » qui partent après une erreur, ce qui cache si la règle est mauvaise ou si le message est confus.

- Traiter les cas limites comme négligeables : nouveaux domaines, relais mail d'entreprise, plus addressing et alias.

Faites particulièrement attention à la distinction « bloqué vs abandonné ». Un utilisateur bloqué est une décision de politique. Un utilisateur abandonné est souvent un problème UX, comme un texte d'erreur vague ou aucun chemin pour corriger une faute.

Enfin, surveillez le sur-blocage. La détection d'emails jetables est utile, mais il est facile d'attraper des adresses légitimes par erreur, surtout venant de nouveaux domaines ou de relais d'entreprise. Des outils comme Verimail aident en combinant contrôles de syntaxe, vérification de domaine et MX, et correspondance avec des blocklists pour que votre test porte sur la politique, pas sur des faux positifs accidentels.

Checklist rapide avant lancement

Avant de commencer, alignez tout le monde sur ce que « succès » et « sûr de continuer » signifient. La plupart des tests de validation stricte échouent parce que le déploiement était vague, le dashboard manquait de signaux clés ou l'équipe ne savait pas expliquer pourquoi un utilisateur réel s'est fait bloquer.

Écrivez les variantes en langage clair. Exemple : Contrôle accepte toute adresse qui passe les vérifications de syntaxe et de domaine, tandis que la Variante bloque les fournisseurs jetables connus et les motifs suspects. Documentez aussi la montée en charge du trafic (par exemple 5% → 25% → 50%) et le trigger exact de rollback (comme « la conversion d'inscription chute de plus de X% pendant Y heures »).

Voici une checklist rapide à revoir avec growth, engineering et support :

- Variantes et étapes de déploiement documentées, y compris qui actionne l'interrupteur et comment revenir en arrière en quelques minutes.

- Votre dashboard est prêt et surveillé : conversion d'inscription, activation (première action clé), taux de rebond, plaintes spam et signaux de fraude (rétrofacturations, multiples inscriptions par appareil, clusters IP suspects).

- Segments convenus à l'avance, avec des attentes d'échantillon réalistes (nouveaux vs récurrents, payant vs organique, géos, et domaines pro vs perso).

- Le logging est assez détaillé pour déboguer : chaque décision bloquer/autoriser inclut un code raison plus le domaine de l'email et la catégorie du fournisseur (par exemple jetable, boîte gratuite, domaine personnalisé).

- Support et ops ont un playbook court : quoi dire aux utilisateurs bloqués, comment collecter des exemples et comment escalader rapidement les faux positifs.

Faites une petite répétition en environnement sûr (comptes internes ou minuscule portion de trafic). Si vous ne pouvez pas expliquer cinq décisions au hasard (pourquoi elles ont passé ou échoué), vous n'êtes pas prêt à l'exposer aux inscriptions réelles.

Exemple : durcir les règles sur les jetables sans couler les essais

Gérer prudemment les inscriptions jetables

Détectez tôt les fournisseurs jetables et choisissez alerter, vérifier ou bloquer par segment.

Une équipe SaaS B2B fait un essai gratuit. Les inscriptions sont bonnes, mais les ventes se plaignent : beaucoup de leads disparaissent et le support voit des comptes spammy. Un audit rapide montre un motif : beaucoup d'essais utilisent des boîtes jetables puis n'activent jamais.

Avant de rien changer, ils posent une ligne de base pour la politique actuelle (autoriser tous les emails). Pendant deux semaines, ils suivent le taux de rebond du premier email, le taux essai→activation (par exemple accomplissement de la première action clé) et les « mauvaises inscriptions » (comptes signalés pour abus ou détails manifestement faux). Ils ajoutent aussi un garde-fou : le taux global d'inscription ne doit pas chuter au-delà d'un seuil convenu.

Puis ils testent trois expériences :

- Contrôle : autoriser les emails jetables comme aujourd'hui.

- Avertissement doux : autoriser, mais afficher un message clair (« Utilisez une adresse professionnelle pour obtenir l'accès complet ») et demander une confirmation.

- Blocage strict : rejeter les fournisseurs jetables connus et demander une autre adresse.

La validation utilise une vérification fournisseur jetable plus une hygiène basique (syntaxe, domaine, MX). Avec une API comme Verimail, cela se fait en un appel à l'inscription, donc chaque variante reçoit une détection cohérente.

Le déploiement est progressif. Ils commencent par le trafic payant uniquement, car il tend à attirer plus d'abus et a un ROI plus clair. Si les garde-fous tiennent après quelques jours, ils étendent aux autres sources.

La décision n'est pas « une politique pour tous ». Les résultats montrent que le blocage strict améliore l'activation et réduit l'abus dans les segments à haut risque (recherche payante, certains géos, remplissage de formulaire très rapide), mais nuit à la conversion dans les segments à faible risque (invités, trafic organique de marque). Ils gardent le blocage strict là où il rapporte et utilisent l'avertissement doux ailleurs.

Prochaines étapes : faire de la validation stricte une partie stable de votre système de croissance

Une fois que vous avez un gagnant clair, traitez-le comme un changement produit, pas une astuce growth ponctuelle. L'objectif est la cohérence : les mêmes entrées doivent mener à la même décision à chaque fois, avec un chemin de rollback rapide.

Écrivez la politique gagnante comme un ensemble de règles simples et associez-la à des segments. Par exemple : les comptes nouveaux venant de géos à haut risque ont une détection jetable plus stricte, tandis que les utilisateurs récurrents de confiance n'ont que des contrôles basiques.

Continuez à surveiller après la fin du test

La qualité des emails n'est pas statique. Les fournisseurs jetables apparaissent, les spam traps tournent et les motifs de fraude changent. Mettez en place une revue hebdomadaire qui se concentre sur les résultats, pas seulement le volume d'inscriptions.

Suivez un petit ensemble de signaux qui doivent évoluer dans la bonne direction si votre porte fonctionne : taux de rebond et rebonds durs sur les emails d'activation, taux de plaintes spam et pics de désabonnement, essai→activation et rétention de la première semaine, indicateurs de fraude comme inscriptions répétées par appareil ou IP, et tickets support concernant les inscriptions bloquées.

Automatiser la validation pour que la règle soit fiable

Les contrôles manuels ou une logique client incohérente créent des résultats bruyants et des expériences injustes. Intégrez la validation dans votre flux d'inscription pour que chaque requête soit évaluée de la même manière, rapidement.

Si vous voulez une approche API, Verimail (verimail.co) peut valider syntaxe, domaines, enregistrements MX et fournisseurs jetables en un seul appel, ce qui aide à garder les politiques cohérentes sur web, mobile et inscriptions partenaires.

Commencez petit même après avoir « choisi un gagnant ». Déployez sur un petit pourcentage, surveillez les garde-fous pendant une semaine entière, puis étendez. Gardez un chemin de rollback clair (feature flag ou configuration) pour assouplir rapidement la porte si la croissance ou la délivrabilité commence à chuter.

FAQ

Que signifie concrètement rendre une porte de qualité d'email « plus stricte » ?

Commencez par définir ce que « plus strict » change pour l'utilisateur : alerter, demander une vérification, ou bloquer ? Le choix le plus sûr est de resserrer la détection tout en gardant d'abord une issue douce, puis d'escalader uniquement si la qualité s'améliore sans casser les garde-fous de conversion.

Pourquoi une validation plus stricte peut-elle nuire à la croissance même si elle améliore la qualité des emails ?

Les faux positifs sont le principal risque. Une adresse valide peut échouer à cause d'un problème DNS temporaire, d'une configuration de courrier d'entreprise atypique ou d'un domaine récent, et l'utilisateur voit juste « échec d'inscription » et part. Rendre les règles plus strictes ajoute aussi de la friction si cela implique des étapes supplémentaires ou des messages d'erreur confus.

Quand dois-je utiliser une porte douce, une vérification ou un blocage strict ?

Utilisez une porte douce quand vous voulez peu de friction et seulement inciter au bon comportement. Choisissez une porte de vérification quand vous avez besoin d'une plus grande confiance avant l'accès à des actions clés. Optez pour un blocage strict quand l'abus coûte cher et que le signal est fiable (par exemple syntaxe invalide claire ou domaine réellement injoignable).

Quelles métriques dois-je suivre pour juger si une validation plus stricte en vaut la peine ?

Suivez une métrique de croissance principale comme la complétion d'inscription ou l'activation, puis complétez avec des métriques de qualité et de risque en aval. Choix pratiques : taux de rebond du premier e-mail, taux d'emails vérifiés, rétention précoce, taux de jetables, signaux d'abus et tickets support liés aux inscriptions ou aux e-mails manquants. Définissez des garde-fous clairs pour arrêter si l'expérience se dégrade.

Quels segments importent le plus quand on teste des changements de validation d'email ?

Si vous regardez seulement la moyenne, vous pouvez rater les endroits où une règle bloque silencieusement de bons utilisateurs. Segmentez par canal d'acquisition, région/langue, nouveaux vs récurrents, et emails professionnels vs personnels, puis ajoutez une séparation simple « à risque » basée sur vos signaux de fraude/abus. Gardez la segmentation stable pour éviter le cherry-picking après coup.

Comment éviter des résultats incohérents quand les utilisateurs réessaient avec différentes adresses ?

Verrouillez l'utilisateur sur une variante la première fois qu'il est vu, idéalement par ID utilisateur ou un cookie stable plus l'adresse saisie. Décidez aussi comment gérer les tentatives multiples : gardez la même variante et loggez chaque essai pour mesurer la friction supplémentaire séparément de l'abandon réel.

Quelle est une manière sûre de déployer des règles plus strictes sans surprises ?

Canary d'abord, puis montez en pourcentages. Un plan pratique : 1% pendant un jour, puis 5%, puis 25%, puis 50%, en surveillant la complétion d'inscription, le taux d'erreur à l'étape email, la latence de validation et le volume de support à chaque étape. Gardez toujours un interrupteur d'urgence pour revenir en arrière sans déploiement.

Comment renforcer la validation sans rendre l'inscription punitive ?

Mettez l'accent sur la clarté et la récupération rapide. Dites aux utilisateurs quoi faire ensuite (corriger une faute de frappe, essayer une autre adresse ou vérifier), et facilitez la réessai. Beaucoup d'« mauvais » emails ne sont que des erreurs typographiques, donc un message utile et des chemins de correction rapides préservent souvent la conversion même quand la détection est plus stricte.

Quelles sont les erreurs les plus courantes qui rendent ces tests trompeurs ?

Ne faites pas trop de choses en même temps. Ne changez pas les règles de validation et réécrivez le formulaire ou déplacez les éléments UI dans le même test, sinon vous ne saurez pas ce qui a causé le résultat. Évitez aussi de juger le test uniquement par le volume brut d'inscriptions : il faut des signaux en aval (rebonds, activation, abus) pour savoir si vous avez réellement amélioré le business.

Comment Verimail peut-il m'aider à renforcer la détection d'emails jetables sans bloquer des utilisateurs réels ?

Utilisez des issues différentes selon les types de risque au lieu de tout traiter comme « refuser ». Avec une API comme Verimail, vous pouvez séparer les adresses invalides des adresses jetables et appliquer des issues telles que blocage strict pour une syntaxe/MX invalide, mais vérification ou avertissement pour les correspondances jetables. Ainsi vous réduisez les inscriptions de faible qualité tout en protégeant les utilisateurs légitimes contre des blocages accidentels.